Utilisations et perceptions de l’IA dans l’humanitaire

Sphère a récemment sondé les organisations humanitaires sur l’intelligence artificielle (IA), et il en ressort que :- 51 % des organisations interrogées déclaraient utiliser, ou envisager d’utiliser, l’IA ;

- 57 % n’avaient reçu aucune formation ni directive sur l’IA, ou ignoraient l’existence de politiques organisationnelles relatives à son utilisation ; et

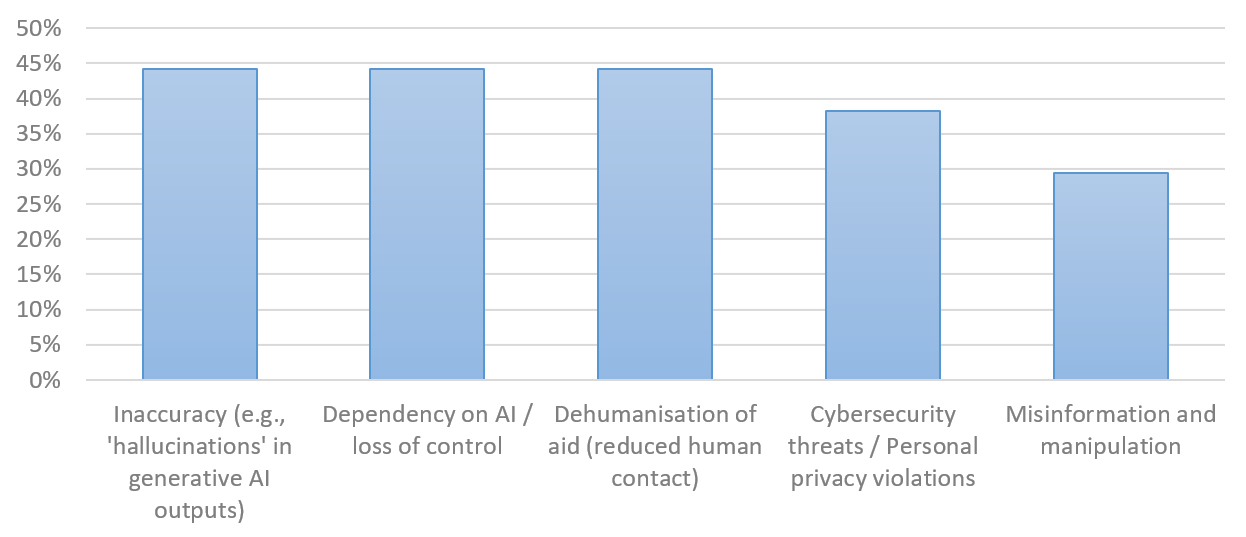

- 6 % seulement disaient être très au courant des risques associés à l’IA.

On IA ou on IA pas ?

L’IA a le potentiel d’apporter des choses positives au secteur humanitaire, mais également celui d’entraîner des dommages pour les populations vulnérables. Comment les organisations humanitaires, ou les personnes responsables des achats dans ces organisations, peuvent-elles prendre de bonnes décisions quant au moment, au lieu et à la manière d’utiliser l’IA ? Comment ces organisations peuvent-elles prouver aux bailleurs potentiels qu’elles ont recours à l’IA de manière responsable et sans risques ? Ou, si l’on se place de l’autre côté du miroir : comment les bailleurs peuvent-ils s’assurer que leurs bénéficiaires potentiel·les utiliseront l’IA de manière responsable ? Et comment aider les humanitaires qui souhaitent bénéficier des avantages de l’IA à le faire sans risques ?Le label AI Safety

Plusieurs approches pour répondre à ces questions, dont celles du renforcement des capacités, des standards ou directives, et de la certification. Sphère collabore actuellement avec Nesta, l’agence britannique œuvrant pour le bien commun, Data Friendly Space et le CDAC Network, avec le soutien de FCDO et de l’UKHIH, à la mise en place d’un label de sécurité de l’IA (AI Safety, en anglais). Et si vous pouviez prouver que l’utilisation que votre organisation fait d’une certaine plateforme de l’IA, dans un contexte donné, dépasse le seuil de sécurité minimal ?Un processus d’évaluation en trois temps

Notre concept de label de sécurité de l’IA repose sur trois composantes clés :- L’évaluation technique : sous forme de tests de la plateforme d’IA à l’aide de mesures telles que la performance, la précision, l’utilisabilité, les biais, la consommation de ressources, la transparence, l’explicabilité, la latence, la rapidité, etc.

- L’évaluation des capacités organisationnelles : la vérification que l’organisation humanitaire qui souhaite recourir à une plateforme d’IA en a les capacités. Un exemple : si le modèle d’IA a besoin de données personnelles ou sensibles, l’organisation prend-elle des précautions suffisantes en matière de cybersécurité ? Le personnel a-t-il reçu la formation adéquate à l’utilisation de la plateforme d’IA ?

- L’acceptabilité sociale et l’évaluation des risques : un système qui fonctionne correctement dans un contexte donné peut être néfaste dans un autre contexte, et l’évaluation de l’adéquation en contexte passe notamment par l’acceptation par la communauté des décisions prises à partir des résultats obtenus sur la plateforme d’IA.

Consultation à l’échelle du réseau Sphère

Nous avons demandé aux personnes participant à notre Forum mondial des points focaux 2024 à Antalya d’imaginer ce à quoi ce label pourrait ressembler, et leur avis sur la faisabilité d’une évaluation organisationnelle des capacités requises pour utiliser l’IA en toute sécurité. Cette session a confirmé que l’IA intéresse globalement grandement notre secteur mais, qu’à l’heure actuelle, peu d’organisations ont les capacités de gérer les complexités techniques, les exigences juridiques et les considérations éthiques nécessaires pour prendre de bonnes décisions en matière d’IA.

Test auprès des communautés dans la province de Hataya

Pour tester la troisième composante de notre évaluation, nous avons organisé deux ateliers, en turc, avec des personnes des communautés touchées par le grave séisme de février 2023. Dans ce cadre, nous avons demandé aux personnes présentes leur ressenti quant à l’utilisation d’images satellites par une plateforme d’IA pour évaluer les dommages causés à leur maison lors du tremblement de terre.

Prochaines étapes et appel à l’action

Notre étude a démontré que le concept de label de sécurité trouve un écho chez les humanitaires, et nous menons actuellement de nouveaux tests pour nous assurer qu’il réponde à la variété des besoins dans le secteur. Si votre organisation étudie l’intersection entre l’IA et l’engagement des communautés, et que vous vous demandez comment utiliser l’IA de manière sûre et responsable, n’hésitez pas à nous contacter.Pour toute question des médias et des informations supplémentaires sur le label de sécurité de l’IA, contacter communications@spherestandards.org.